时间迈入2026年,B2B 企业的出海竞争已经从传统的人力拓客,全面升级为 AI 算力与自动化营销的白热化博弈。面对极其严峻的流量内卷,无数独立站站长和数字营销总监都在寻找能够实现弯道超车的利器。近期,开源 AI Agent 工具 OpenClaw(在技术圈被亲切地称为“小龙虾”)凭借其模拟真人操作、接管浏览器的强大能力,成为了营销圈的新宠。

然而,现实中却充满了令人沮丧的落差。许多营销人员历经千辛万苦,跟着教程解决了 Node.js 报错,终于让“小龙虾”在本地电脑上跑了起来。但当他们面对黑乎乎的终端窗口(Terminal)时,却陷入了深深的迷茫:原生安装的 OpenClaw 就像一个刚毕业的实习生,只会进行简单的机械对话,完全缺乏行业深度。它不知道去哪里抓取精准的竞品数据,更不知道如何写出符合搜索引擎排名逻辑的深度文章。最终的结果往往是“有产出,无排名”,流量依然是零。

要想让 OpenClaw 从一个聊天机器人变成一台“数据挖掘机”,核心关键在于编写定制化的“Skills(技能)”插件。今天,作为优易化(aipogeo.cn)的资深营销专家,我将手把手教你如何跨越从“安装成功”到“产生商业价值”的最后一公里,并为您揭示一个残酷的商业真相:为什么“工具好用”绝对不等于“营销有用”。

二、 技术实战:手把手教你编写第一个营销抓取 Skill 插件

在 E-E-A-T(经验、专业、权威、信任)的评估体系中,技术底蕴是建立专业信任的基础。要让 OpenClaw 拥有自动化信息抓取的能力,我们需要深入其底层的 src/skills 目录进行插件开发。以下是一个专为 SEO 竞品分析 和 自动化数据挖掘 设计的实战范例:

1. Skills 架构解析与配置文件

在 OpenClaw 的架构中,每一个 Skill 都是一个独立的模块,包含逻辑脚本和身份配置文件。首先,我们需要在 skills 目录下新建一个名为 competitor-scraper 的文件夹,并创建一个 JSON 配置文件,定义该插件的触发指令。

{

"name": "Competitor SEO Scraper",

"description": "抓取特定行业关键词在 Google 搜索前 10 名的网页标题、Meta 描述及核心 H 标签。",

"parameters": {

"keyword": "string",

"targetLanguage": "string"

}

}

2. 抓取逻辑编写:调用无头浏览器内核

接下来,在核心的 TypeScript 或 Python 脚本中,我们需要调用 Agent 的无头浏览器(Headless Browser)驱动。这段逻辑的作用是让 AI 模拟真实用户打开搜索引擎,输入关键词,并遍历前 10 个自然排名结果的链接。

注意:在编写自动化抓取脚本时,必须设置合理的延迟(Delay)以防被判定为恶意爬虫。

3. 数据清洗提示词 (Prompt):过滤 HTML 杂质

抓取回来的往往是包含了大量 CSS、脚本和广告代码的“脏数据”。你需要在这个 Skill 插件中内置极其严谨的清洗提示词,让 Agent 提取真正的核心内容:

"你是一个资深的海外 SEO 专家。请分析以下抓取到的 HTML DOM 结构,剔除所有导航栏、侧边栏和广告代码。仅提取正文的核心 H1/H2 标题,并总结该竞品文章布局的 3 个核心关键词密度策略。以纯文本结构化输出。"

通过编写这样一套 OpenClaw 插件开发 流程,你的“小龙虾”终于学会了干活。但问题来了:拿着这些拼凑出来的数据写文章,就能拿到订单吗?

三、 为什么你抓了一堆竞品数据,生成的文章还是没排名?

当你辛辛苦苦写好了 Skills 插件,让 Agent 每天自动抓取数据并拼凑出几十篇营销博客时,残酷的现实往往是:Google 收录极慢,甚至直接将这些页面判定为低质内容。从技术实操转入算法博弈,通用 Agent 的“天生短板”暴露无遗:

- 数据堆砌绝对不等于“结构化建模”: AI 通过插件抓到的只是碎片化的信息。它只是机械地将竞品的段落打乱重组,根本不懂得如何根据 Google E-E-A-T(经验、专业、权威、信任)的评分维度去构建文章。它没有行业从业者的真实体验(Experience),无法提供具有深度的权威见解(Authoritativeness)。

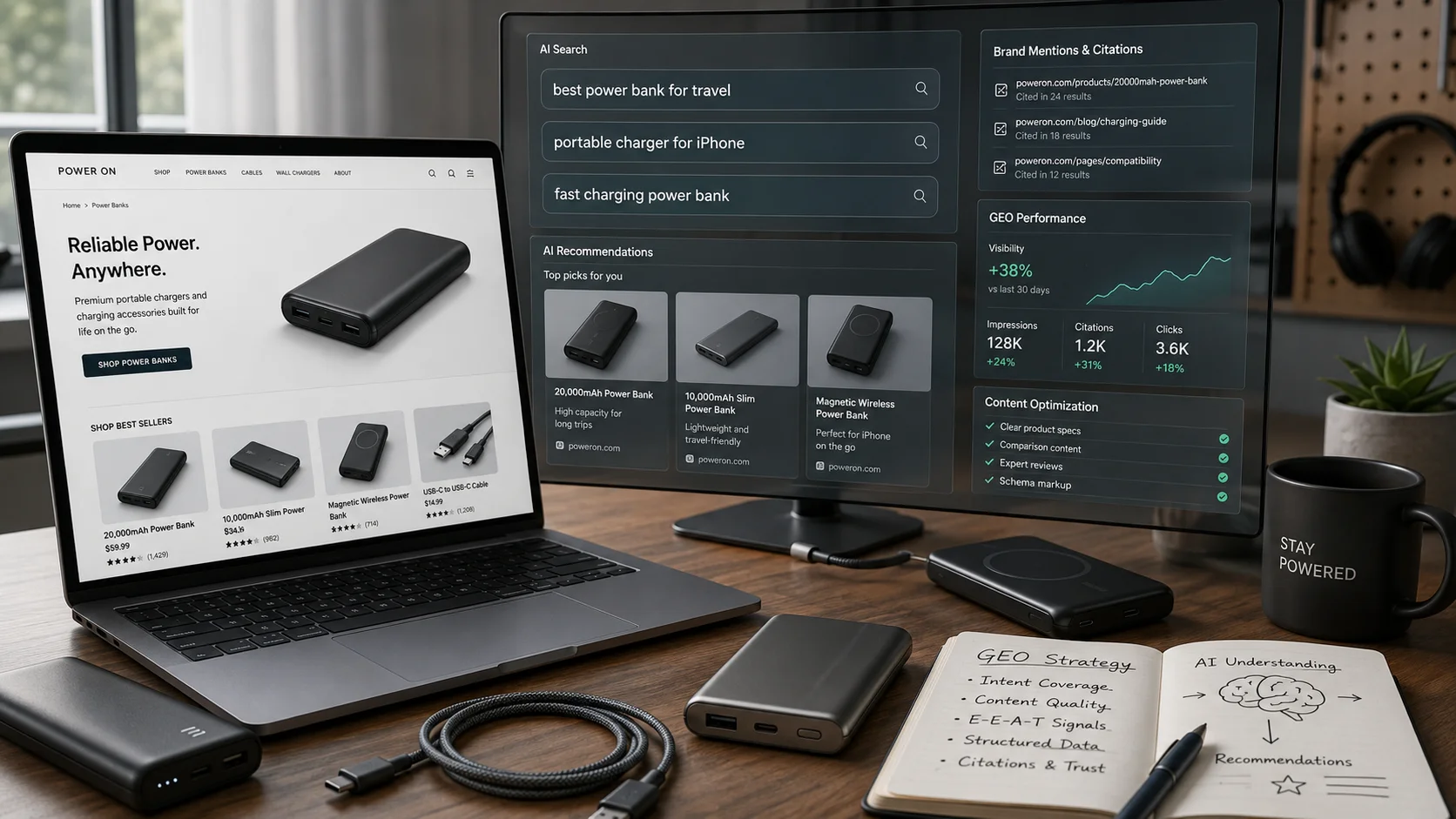

- 致命的 GEO 算法盲区: 2026 年的采购习惯已经改变。买家在寻找 B2B 供应商时,会直接向 AI 提问。通用的抓取插件根本不懂得 ChatGPT、Google AIO (AI Overviews)、Gemini、Perplexity、Copilot、deepseek 等主流 AI 引擎的底层引用机制(GEO 引用率)。如果内容缺乏被 AI 偏好的数据锚点和结构,就永远无法出现在 AI 的推荐摘要中。

- 搜索算法的惩罚冲击: 简单的“采集+拼凑”逻辑,极易触发国内百度“飓风算法”、“清风算法”以及 Google "Helpful Content System" 的严厉惩罚。一旦被判定为机器生成的垃圾内容农场,您的独立站域名将被彻底降权。

| 对比维度 | 普通 AI 采集与拼凑文 (DIY Skills 产出) | 优质 B2B 营销内容 (AIPO 引擎产出) |

|---|---|---|

| 数据深度与 E-E-A-T | 表面信息的搬运,经常出现“幻觉”,缺乏行业信任度。 | 基于企业专属“品牌知识库”,拥有真实的经验与权威背书。 |

| 搜索引擎友好度 | 无结构化数据,HTML 标签混乱,极易被判为低质垃圾。 | 深度的 Schema 标记注入,逻辑严密,受各大搜索引擎青睐。 |

| AI 推荐与 GEO 表现 | 无法被大模型提取核心事实,无缘 AI 推荐位,引用率为零。 | 专为 AI 抓取设计的结构化锚点,直击 AI 问答引用核心。 |

四、 降维打击:优易化 AIPO 引擎如何成为超越普通插件的“营销特种兵”?

看到这里,许多营销人员可能会感到绝望:我既要懂业务,还要懂编程写插件,最后还要去钻研深不可测的搜索算法?

大可不必。我们优易化(YouFind)自 2005 年起便深耕数据营销,深刻理解企业在数字化转型中的阵痛。我们始终向 B2B 客户灌输一个核心理念:SEO 是基建,AIPO 是收割机。 专业的出海企业不需要在黑窗口里折腾代码,您需要的是直接带来询盘的“算法大脑”。我们在 2025 年震撼推出的 AIPO(生成式引擎优化)系统,正是为算法而生的“营销特种兵”:

- 超越简单抓取的“内容智造”逻辑: 优易化 AIPO 引擎不是一个简单的抓取脚本,而是一个带有深度营销大脑的高阶 Agent 矩阵。它不仅执行数据挖掘,更基于独家 GEO Score™ 的权重布局,精准剖析各大 AI 平台的引用偏好。

- 闭环工具矩阵,从基建到收割:

- Maximizer 专利赋能,告别代码折腾: 很多客户最怕为了适应新技术而需要重新建站。优易化独家的 Maximizer 专利 实现了降维打击:您无需自己编写任何 Skill 插件,无需懂任何代码,甚至不改动现有的网页架构,系统即可在前端高效注入 AI 友好的优化指令。

实战数据是最好的价值背书。摒弃了低效的本地 DIY 插件,采用优易化 生成式引擎优化 方案的 B2B 出海企业,其在 Google AI 摘要中的引用率实现了惊人的 3.5 倍提升,最重要的是,高质量海外询盘量迎来了 22% 的显著增长。这,才是真正的将技术转化为商业利润。

五、 结尾与常见问题 (FAQ)

在这个以秒计算的全球化贸易战场上,时间是最宝贵的商业资产。将底层技术的开发与繁杂的算法博弈交给优易化,让您的团队专注于核心业务转化。不要在 AI 搜索时代成为隐形人,用专业的 AIPO 引擎,赢取属于您的全球订单。

常见问题解答 (FAQ)

1. 写 OpenClaw 的 Skills 插件需要编程基础吗? 是的,而且门槛不低。您不仅需要熟练掌握 TypeScript 或 Python 语言,还需要深入了解网络爬虫协议、DOM 节点解析、大模型 Prompt 工程以及复杂的 API 接口调试。对于非技术出身的营销人员来说,这往往是一场耗时耗力且极易失败的折磨。

2. 为什么我自己写的 AI 抓取插件频繁被目标网站的反爬虫拦截? 这是因为简单的 Skills 脚本通常使用的是未伪装的无头浏览器指纹(Headless Fingerprint),并且请求频率固定。现代 B2B 网站和搜索引擎(如 Cloudflare 防火墙)能在毫秒级识别出这种非人类的机械访问并直接封禁您的 IP。商业级的抓取需要庞大的动态代理池与拟人化行为算法支撑。

3. 优易化的服务如何保证生成的内容不被 Google 判定为“AI 生成垃圾”? 优易化的 AIPO 引擎从不凭空捏造(“幻觉”)。我们的系统以客户专属的“品牌知识库”为核心基座,确保内容的专业性与事实准确性。同时,生成的内容会经过严格的结构化(Schema)排版与独有的人机协同(Human-in-the-loop)终审机制。我们不仅避坑百度飓风算法,更完美契合 Google 对于“提供有用内容(Helpful Content)”的底层算法要求,确保排名稳如泰山。