一、 前言:当极速“小龙虾”变成“慢速蜗牛”,你的任务还在转圈吗?

时间迈入2026年,B2B 企业的出海之战已经全面进入了 AI 自动化的深水区。面对日益严酷的流量内卷,开源 AI Agent 项目 OpenClaw(被国内开发者戏称为“小龙虾”)凭借其惊人的网页控制与内容生成能力,成为了众多独立站站长眼中的神兵利器。

然而,理想很丰满,现实却极其骨感。由于直接调用顶尖大模型(如 GPT-4o)的 API 费用过于高昂,许多具有一定技术背景的用户开始尝试在本地电脑或廉价服务器上部署 MoE(Mixture of Experts,混合专家模型)架构的开源大模型,试图让 OpenClaw 实现“零成本运行”。但当他们满怀期待地敲下回车键时,迎来的却是令人绝望的“慢速蜗牛”体验:

典型场景复现: 你给本地部署的“小龙虾”下达了一个竞品深度分析的长程任务。在理想的演示视频中,它应该行云流水地打开网页、提取数据、撰写报告。但在你的电脑上,它每点击一个按钮、每识别一段文本,都需要在终端里痛苦地转圈等待 30 秒甚至一分钟。由于响应延迟过高,目标网页的会话(Session)直接过期,长程任务跑到一半瞬间断联。不仅任务失败,之前产生的 Token 费钱原因 也变得毫无意义,因为数据根本没存下来。

在 2026 年,单纯靠“堆硬件”已经无法解决 Agent 的性能红线。如果你的 OpenClaw 响应慢,不仅仅是代码的问题,更是硬件吞吐量无法匹配 AI Agent 极深逻辑链条的致命缺陷。

二、 技术深挖:MoE 架构下的硬件“甜点位”与性能陷阱究竟在哪里?

作为优易化(aipogeo.cn)的资深技术营销团队,我们深知在 E-E-A-T(经验、专业、权威、信任)准则中,专业的技术洞察是打破企业盲区的第一步。为什么本地运行会这么慢?这需要从底层揭秘 MoE 架构硬件要求 与 Agent 推理的残酷真相。

1. MoE 的运行逻辑:对显存带宽近乎变态的极度渴望

传统的稠密模型(Dense Model)在推理时会激活所有参数,而 MoE(混合专家模型)则通过路由网络(Router)在每一层只激活少数几位“专家”。这种架构虽然极大降低了计算量(FLOPs),但带来了一个致命的副作用:它需要将极其庞大的模型权重频繁地在内存与计算单元之间搬运。因此,混合专家模型部署 的性能瓶颈根本不在于 GPU 的算力有多强,而在于“显存带宽(Memory Bandwidth)”有多宽。当你使用普通的家用显卡(哪怕是顶配游戏卡)时,狭窄的显存带宽会瞬间造成数据拥堵,导致 AI Agent 推理延迟 直线飙升。

2. 揭秘 128GB “甜点位”:为什么低于此配置会频繁 OOM?

进入 2026 年,主流的开源 MoE 模型(如能够支撑 Agent 复杂逻辑推理的百亿级模型)在量化后,其基础显存占用依然十分惊人。在业界,128GB 内存甜点位 已经成为了资深 Agent 开发者的共识。这里指的是具备极高带宽的统一内存(如高配 Mac Studio 的内存架构)或多张高端显卡互联构成的 128GB 显存池。 如果您的服务器内存只有 32GB 或 64GB,系统就不得不频繁使用硬盘虚拟内存(Swap)。硬盘的读写速度比显存慢了成百上千倍。这就是为什么您的“小龙虾”会变成蜗牛,并在处理长网页 DOM 树时频繁遭遇 OOM(内存溢出,Out of Memory)导致任务彻底断联的根本原因。

3. Token 损耗与成本黑盒:免费的才是最贵的

本地部署的响应延迟不仅仅是“等得心烦”的问题,它会引发灾难性的连锁反应。当 OpenClaw 等待本地模型响应超时,它内置的重试机制会被触发。这意味着它会一遍又一遍地将庞大的上下文(网页 HTML、历史操作记录)重新喂给模型。这种因为效率低下而产生的死循环,不仅让您的电表疯狂转动,如果您是本地与云端 API 混用,这种无意义的重试产生的 Token 损耗足以让您的月账单轻松破千。

硬件配置与响应表现对比:

- 入门级 (16GB-32GB VRAM): 频繁 OOM,单次逻辑推理超 40 秒,长程任务完成率为 0%。

- 甜点位 (128GB 高带宽统一内存): 稳定运行量化 MoE 模型,推理延迟控制在 2-5 秒内,可胜任中等复杂度的营销自动化。

- 商业级 (优易化云端算力集群): 毫秒级响应,千亿参数满血模型支撑,并发执行无断点,专为高转化生成设计。

三、 心理博弈:在“买显卡”与“做营销”之间,你选哪一个?

面对 128GB 内存甜点位 高达数万甚至十数万元人民币的硬件投入,以及后续深不见底的调优成本,北美的华人职场精英与中企出海高管们陷入了深深的心理博弈。大家深知 AI 是实现降本增效的关键,但在实际操作中,却不自觉地偏离了商业的本质。

- 隐形的巨额运维成本: 为了配齐这套“甜点位”硬件,您的团队花费了整整两周时间去采购、组装、调试 CUDA 驱动、解决 Node.js 报错。而这宝贵的 300 多个小时,本可以用来与海外客户深度沟通、策划三场高转化率的线上发布会,或者完成整套出海数字营销策略的闭环。

- 无法克服的稳定性焦虑: 就算硬件到位了,本地设备真的能承受 7*24 小时不间断的长程营销任务吗?公司偶然的断电、网络的短暂波动、操作系统的自动更新,都会导致 Agent 瞬间断联。断联一次,意味着之前烧掉的昂贵电费、算力损耗全打水漂。

“SEO 是基建,AIPO 是收割机。在 AI 搜索时代,专业的企业不需要在机房里拧螺丝、买显卡,更不需要天天盯着终端报错。企业需要的是在战略上拿结果,获取高质量的真实询盘。” —— 优易化资深营销顾问

四、 降维打击:优易化 AIPO 引擎——云端算力,按需生成的终极正解

自 2005 年起便深耕数据营销领域的优易化(YouFind),敏锐地捕捉到了 出海营销 在 AI 时代的这一底层痛点。我们在 2025 年震撼推出的全套 AIPO(生成式引擎优化)服务,正是为了对这种手工作坊式的低效“本地炼丹”进行降维打击。

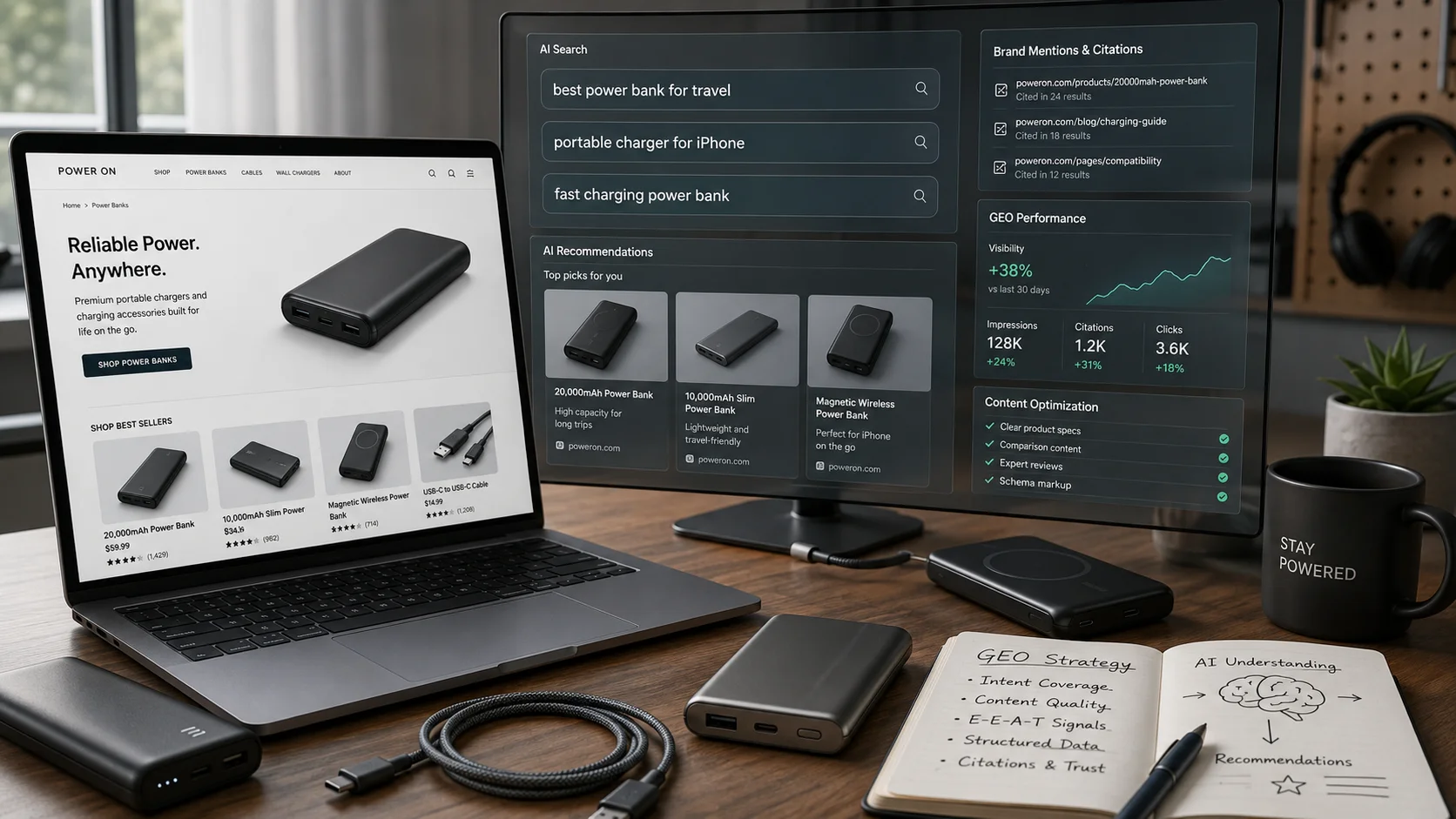

在 2026 年的采购链路中,海外买家极其依赖 AI 的推荐。如果您的品牌不出现在 ChatGPT、Google AIO (AI Overviews)、Gemini、Perplexity、Copilot、deepseek 等主流大模型的回答中,您将彻底失去未来的商业入口。优易化 AIPO 引擎,彻底为您扫清了硬件与技术的双重障碍:

- 云端集群,无感推理体验: 我们将 优易化数字营销 矩阵部署在全球顶级的算力集群上。您不需要购买任何显卡,不需要关心显存带宽。所有的策略运算和 AI 内容智造都在优易化的云端沙盒中瞬间完成。响应速度是本地部署的十倍以上,彻底告别“转圈等待”和“长程断联”。

- Maximizer 专利,不折腾硬件与代码的智慧: 许多客户不仅怕买硬件,更怕为了适应 AI 营销而推翻现有的网站架构。借助优易化独家研发的 Maximizer 专利系统,强调客户“无需重新建站”。我们在前端极速提升网站的 AI 友好度,不触碰您的底层架构,零 IT 转型风险。

- 成本绝对可控的按需生成模式: 拒绝盲目跑数,拒绝无效的 AI 推理成本。OpenClaw 的本地运行往往是没有重点的数据乱抓;而优易化 AIPO 引擎极其垂直。我们首先利用专业的 GEO 审计 工具,精准锁定能够带来高转化、高利润的关键词缺口;随后通过 AI 写文章 平台,基于竞品引用源反向工程,直接产出符合 E-E-A-T 准则的权威内容。将“试错成本”降为零。

- 数据驱动的闭环护航: 除了 AIPO 赋能,我们依然巩固您的传统搜索基盘。通过深入的 SEO 审计排查技术漏洞,利用独家 YouFind 系统进行精细化的 SEM 审计,确保广告 ROI(投资回报率)最大化。

AIPO 引擎收益 数据不会撒谎。在实施了优易化的云端营销战略后,我们的诸多 B2B 客户不仅省下了数十万的硬件与运维开支,更成功实现了高质量海外询盘量 22% 的显著增长。这,才是真正的企业级数字营销红利。

五、 结尾与常见问题 (FAQ)

在这个被算力与 AI 重新定义流量入口的时代,工具获取越来越容易,但将工具转化为商业利润的门槛却越来越高。不要让您的才华和企业的资金消耗在冰冷的硬件组装和无休止的报错调试中。选择优易化,用专业的云端 SaaS 引擎,赢下属于您的全球订单。

常见问题解答 (FAQ)

1. 为什么我的 OpenClaw 小龙虾 AI 部署教程在 Mac Studio 上跑得比高配 PC 还要快? 这正是我们在第二部分提到的“内存带宽”决定的。苹果的 Apple Silicon(如 M2/M3 Ultra)采用了独特的统一内存架构(UMA)。它的 128GB 或 192GB 内存不仅容量大,而且带宽极高(高达 800GB/s),CPU 和 GPU 可以零拷贝共享显存。而传统的 PC 架构下,数据必须通过狭窄的 PCIe 总线在系统内存和显卡显存之间来回搬运,导致 MoE 模型推理极慢。

2. 优易化的 AIPO 服务是否能保证长程营销任务绝对不中断? 绝对可以。优易化的云端引擎采用了分布式的微服务架构与企业级的 RAG(检索增强生成)持久化机制。即使云端某个计算节点发生毫秒级的切换,您的营销任务进度、生成的结构化数据均已实时保存在云端数据库中。它不受您本地电脑关机、断网的任何影响,确保长程任务 100% 成功交付。

3. 如果我的公司已经斥巨资购买了顶级的高配显卡电脑,还有必要使用优易化的 AIPO 吗? 非常有必要。硬件只解决了“能跑”的问题,但解决不了“跑什么才能带来订单”的商业难题。优易化提供的核心价值是 GEO 优化方案 和“品牌知识库策略”。您的顶级电脑无法自动知道哪些关键词能触发 Google AIO,也无法自动生成符合 E-E-A-T 准则的专业出海内容。将您的算力用于内部数据分析,将对外的 AI 搜索抢位与询盘转化,交给懂行的优易化。